完全なる思い付き企画、TwitterDeveloperでデータ分析してみた!!

思い付きでザザザーっと今日やった内容をまとめておく!!

TwitterDeveloperの申請をする。

ここは先人たちの素晴らしい記事があったので参考ににつつ・・・と思ったら

昨年の記事の状況ともいろいろ変わってる様だ。

Twitter API 登録 (アカウント申請方法) から承認されるまでの手順 - Qiita

参考記事を見つつGoogleさんに翻訳してもらいつつ進めるも、即時に申請が承認されてTwitter APIが使えるようになった?

Twitter APIを使うツールを準備をする。

公式のDocuments見たらtwurl使えってなってるけど、OAuthに対応してりゃいいんでしょーよ。

とりあえず、APIテストツールの「Postman」を使ってOAuth認証の用意する。

Twitter APIをPostmanで叩く方法 - Qiita

試しにTwitter APIを使ってみる。

Query Paramsに抽出条件を指定するのね・・・。

とりあえず、簡単にデータ取得する上で最低限のクエリは以下の3つぽい。

- q ‐ テキスト検索の条件キーワード

- lang - とりあえず、jaって指定しないと外国語の結果がめっちゃ取れる

- count - デフォルトが15件になってる。少ない。Standardの上限は100件までらしい。

と、いうことで、「RPA」、「WinActor」、「UiPath」、「BizRobo!」、「BluePrism」あたりの検索キーワードで100件づつAPI実行して結果をJSON形式で保存しておく。

JSONをCSVに変換する。

テキストマイニングしたいので、とりあえずJSONをCSVに変換してみた。

以下のPowerShellコードをjson_to_csv.ps1っていう名前で保存して実行。

|

1 2 3 4 5 6 7 |

$json_file = Read-Host "スキャンするファイルを指定して下さい。" $dirpath = [System.IO.Path]::GetDirectoryName($json_file); $csvpath = $dirpath + "\merge.csv" $json = Get-Content $json_file -Encoding UTF8 | ConvertFrom-Json $json.statuses | Export-Csv -path $csvpath -Append -Encoding Default |

プロンプト入力でファイルパス求められるので、JSONファイルを渡せばCSVに変換してくれる。

JSONは、statusesっていうプロパティに配列でデータが入ってたのでそこのフィールドだけ出力してる。

変換したCSVの要らない項目削る。

1行目は消す。Excelの機能を使って重複データを削除する。(idでの重複データを消す)

500件だったクエリ出力結果が476件になった。

textっていうカラムにTweet内容が入ってるのでそのカラムを一番左に持ってきて他は適当に捨てる。

テキストマイニングツール「KH Coder」を使ってみる。

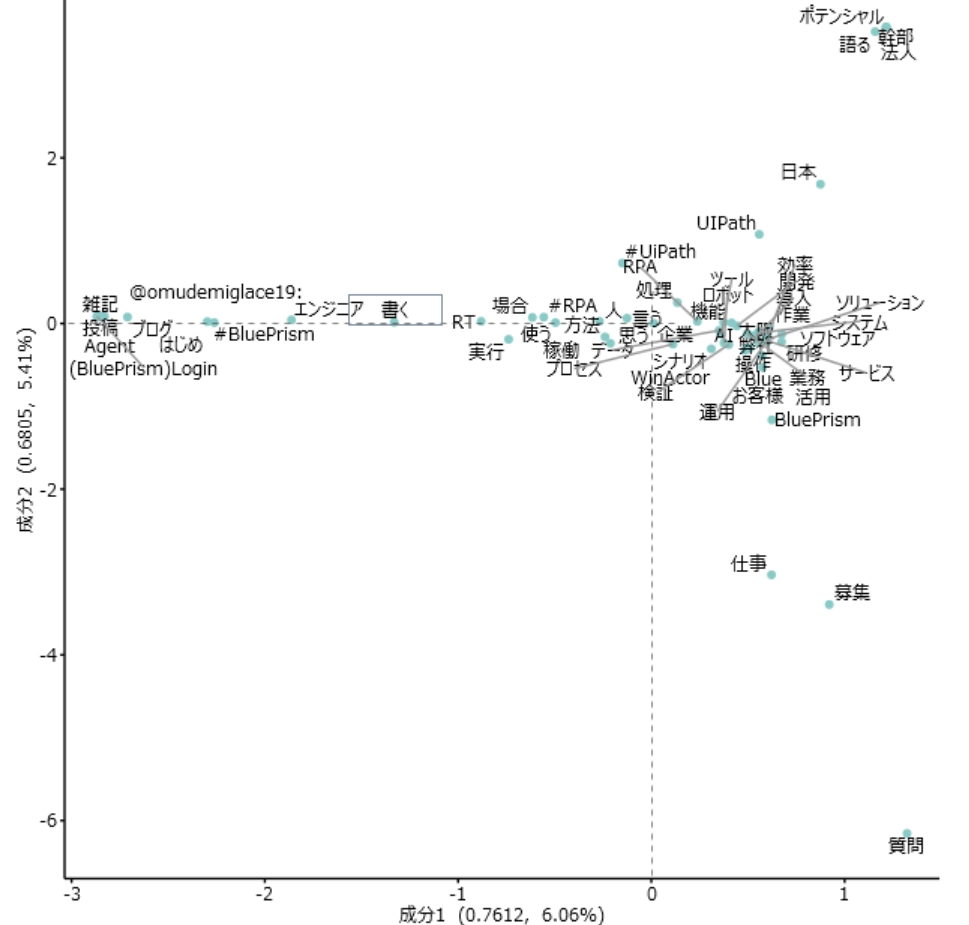

「RPA」、「WinActor」、「UiPath」、「BizRobo!」、「BluePrism」でTwitter検索した結果を抽出後で対応分析した結果がこちら?

データに分類とか設定してなかったから、よーわからん結果になった?

明日から、統計のこと学びつつちゃんと分析できるように試行錯誤してみよう!?